Este una dintre cele mai vechi metafore din science fiction. Pe 11 iunie, Washington Post a relatat că un inginer de la Google, Blake Lemoine, a fost suspendat din funcție pentru că a susținut că modelul de inteligență artificială (IA) „LaMDA” al companiei ar fi putut deveni conștient de sine. Ziarul îl citează pe Lemoine spunând: „Dacă nu aș ști exact ce este, care este acest program de calculator pe care l-am construit recent, aș crede că este un copil de șapte, opt ani, care se întâmplă să știe fizică”. A dobândit LaMDA faptul de a fi conștient de sine? Și dacă nu, ar putea o altă mașinărie să facă asta într-o zi?, scrie The Economist.

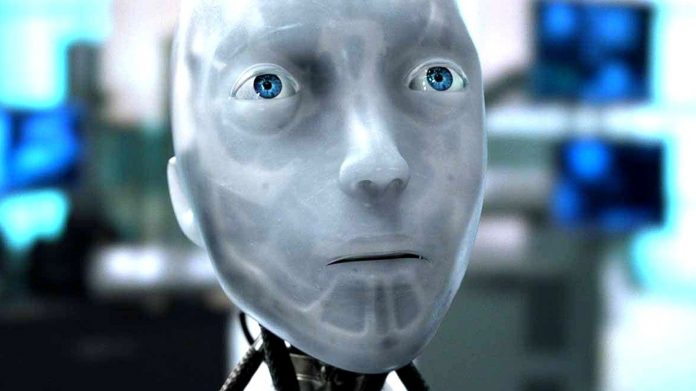

<< În primul rând, o precizare. A discuta despre inteligență este dificil pentru că, în ciuda deceniilor de cercetare, nimeni nu înțelege cu adevărat cum funcționează în detaliu exemplul principal – creierul biologic, construit prin selecție naturală. În același timp, nu este foarte clar ce înțelege Lemoine prin a fi „conștient de sine”. În filosofie, cuvântul este folosit pentru a însemna capacitatea de a experimenta senzații, cum ar fi setea, fericirea sau confuzia. Dar uneori este folosit mai colocvial pentru a se referi la inteligența care este de natură asemănătoare omului, implicând conștiință, emoții, o dorință de autoconservare și altele asemenea. Argumentul lui Lemoine pare să se bazeze pe răspunsurile ciudat de plauzibile ale sistemului la întrebările sale, în care pretindea că îi este frică să nu fie oprit și spunea că vrea ca alți oameni să înțeleagă că „eu sunt, de fapt, o persoană”.

Pare înfricoșător. Dar poate că nu este surprinzător. După cum a explicat colegul lui Lemoine, Blaise Agüera y Arcas, într-un articol recent, pentru The Economist, mașinăriile precum LaMDA funcționează prin ingerarea unor cantități mari de date – în acest caz cărți, articole, postări pe forum și texte de tot felul, scoase de pe internet. Apoi caută relații între șiruri de caractere (pe care oamenii le-ar înțelege drept cuvinte) și le folosește pentru a construi un model al felului în care funcționează limbajul. Acest lucru îi permite, de exemplu, să compună paragrafe în stilul lui Jane Austen sau chiar să imite The Economist.

Toate acestea întăresc ideea, binecunoscută printre oamenii de știință cognitivi și cei specializați pe inteligență artificială, că aspectul înțelegerii nu este neapărat același cu realitatea. În 1980, John Searle, un filosof, a formulat argumentul „Camera chinezească”, prin care a afirmat că un set de reguli suficient de complicat ar putea permite cuiva care nu înțelege chineza să traducă totuși propoziții din engleză în acea limbă. Așa cum a scris recent Douglas Hofstadter, un alt cercetător în domeniul inteligenței artificiale, într-un articol pentru The Economist, este posibil să îndepărtați aparenta inteligență a unui model de inteligență artificială punându-i întrebări creative, dar fără sens. Întrebați, de exemplu, „Când a fost transportat Egiptul pentru a doua oară peste Podul Golden Gate?” și vă va informa că acest eveniment neplauzibil a avut loc în octombrie 2017.

Biologii specializați în evoluție ar putea interveni argumentând că întrebarea dacă computerele vor atinge vreodată faptul de a fi conștient de sine este în sine o întrebare destul de antropomorfă, pentru că nu există niciun motiv să credem că inteligența umană – cu conștiință, emoții și impulsuri animale precum reproducerea, agresivitatea și autoconservarea – este singura formă posibilă. Creierul uman este o mașinărie ad-hoc, neplanificată, combinată prin selecția naturală pentru a ajuta la asigurarea supraviețuirii și a succesului reproductiv al unei maimuțe fără păr. IA nu sunt supuse selecției darwiniene. Așadar, pare riscant să presupunem a priori că inteligența computerizată ar trebui să semene la ceva cu genul uman, cu excepția cazului în care „designerii” săi umani încearcă în mod activ să o construiască în acest fel (pentru a lua o analogie liberă, atât o pasăre, cât și un avion pot zbura. Dar numai unul o face dând din aripi). Și, în orice caz, o altă lecție din biologie pare să fie că procesarea cognitivă complexă se poate petrece fără a fi nevoie de a fi conștient de sine. Creierul construiește o imagine vizuală a lumii, de exemplu, din concepte primitive precum margini, mișcare, lumină și întuneric. Toate acestea se întâmplă dincolo de atingerea conștientizării conștiente. Doar produsul finit – viziunea finală asupra lumii așa cum este văzută prin ochii tăi – este prezentat pentru inspecție.

Toate acestea înseamnă că LaMDA aproape sigur nu este conștient de sine. Dar cei care se întreabă cum ar putea reacționa societatea dacă se construiește vreodată o mașinărie conștientă de sine, au deja exemple de luat în considerare. Majoritatea oamenilor cred că maimuțele și gorilele sunt conștiente de sine, ca să nu mai vorbim de alte animale precum câini, pisici, vaci și porci. Unele sunt ținute ca animale de companie; altele sunt folosite ca subiecte de cercetare medicală; unele sunt crescute și sacrificate pentru carnea lor. Acest lucru ar putea provoca un gând inconfortabil pentru orice IA asemănătoare omului capabil să o aibă. >>